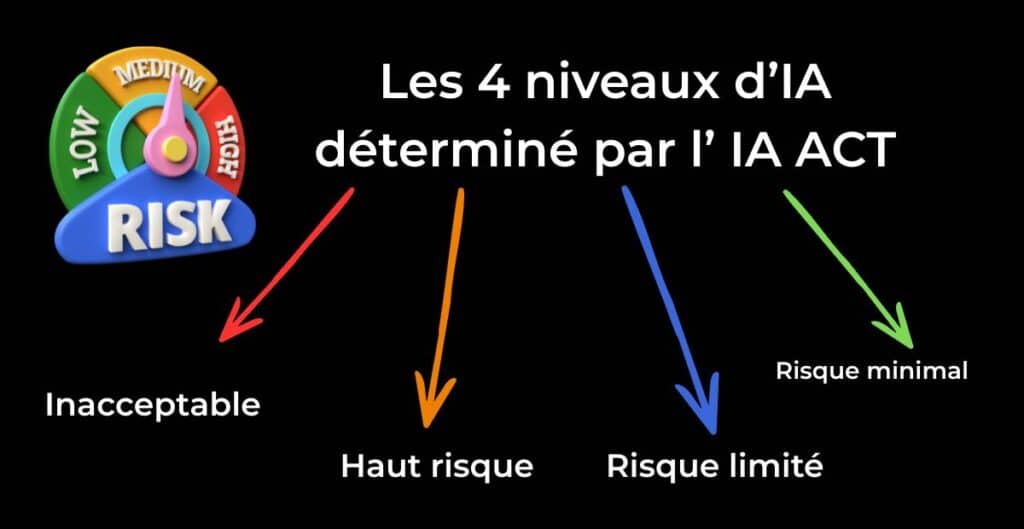

Les 4 niveaux de risque de l’AI Act : quelles intelligences artificielles sont concernées ?

L’AI Act change la donne pour les entreprises en Europe. Le règlement introduit une classification par niveaux de risque. Ce classement va du risque minimal au risque inacceptable. Pour chaque niveau, des obligations spécifiques s’appliquent. Les dirigeants belges doivent identifier où leurs outils se situent.

Sommaire

D’abord, nous décrirons les quatre niveaux et leurs conséquences. Ensuite, nous détaillerons exemples concrets et obligations pratiques pour les PME. Puis, nous aborderons comment auditer et documenter vos systèmes. Enfin, nous parlerons des sanctions et d’une feuille de route pour vous mettre en conformité.

Pourquoi une classification par risque ?

L’AI Act repose sur une logique simple : proportionner les obligations au risque. Cette approche évite d’étouffer l’innovation. En effet, la majorité des outils d’IA actuels restent en zone à risque minimal. Ainsi, seuls les systèmes susceptibles d’affecter gravement les droits ou la sécurité humaine se voient imposer des règles fortes. Pour un dirigeant, cela signifie qu’il faut d’abord cartographier les usages. Par exemple, un chatbot marketing n’aura pas les mêmes contraintes qu’un algorithme de décision de crédit. De plus, la classification favorise l’harmonisation européenne. Cela réduit le coût de conformité pour les entreprises actives dans plusieurs États membres.

Connaître le niveau de risque permet de prioriser les actions. En pratique, les équipes techniques et juridiques doivent collaborer. Elles évaluent l’impact sur la vie privée, la sécurité et les droits fondamentaux. De plus, la méthode couvre le cycle de vie complet du système. Cela va de la conception jusqu’à la surveillance post-commercialisation. En Belgique, cette approche facilite la coordination entre DSI, responsables conformité et opérationnels. En revanche, négliger cette étape expose aux erreurs d’interprétation et aux risques financiers.

Risque minimal : quoi changer dans vos outils ?

Le risque minimal concerne la plupart des systèmes d’IA actuels. Ces solutions ne nécessitent pas d’obligations spécifiques. Cependant, cela ne veut pas dire qu’il faut ignorer la conformité. Par exemple, un assistant interne d’analyse de données implique des contrôles basiques. Il faut garder une documentation sommaire et veiller à la sécurité des accès. De plus, l’intégration d’API externes nécessite des vérifications contractuelles. Pour une PME belge, une revue annuelle rapide permet de confirmer l’absence de risque élevé. Ainsi, vous limitez les surprises lors d’un audit ou d’un changement d’usage.

Conserver une traçabilité minimale facilite la transition si l’outil évolue. En effet, un module initialement anodin peut devenir critique. Par exemple, un plugin de scoring client peut être étendu à l’évaluation de solvabilité. Dans ce cas, le statut pourrait monter en gamme jusqu’au haut risque. De plus, documenter les finalités et les jeux de données employés aide à répondre à des demandes externes. De plus, ces bonnes pratiques renforcent la sécurité opérationnelle et la confiance des clients.

Risque limité : transparence et obligations immédiates

Le niveau limité impose principalement des obligations de transparence. Les utilisateurs doivent être informés lorsqu’ils interagissent avec une IA. Par exemple, un chatbot doit signaler qu’il n’est pas humain. De même, les deepfakes destinés au public exigent un marquage explicite. Pour une PME, cela se traduit par des modifications simples. Insérer des messages clairs dans l’interface suffit souvent. Cependant, il faut aussi garder des enregistrements des versions déployées. Ainsi, vous pourrez prouver la conformité si besoin.

Ce niveau concerne des usages fréquents en entreprise. Par exemple, les assistants virtuels en service client, ou des outils génératifs pour supports marketing. La transparence réduit les risques de tromperie et protège la réputation. En Belgique, les équipes marketing et juridiques doivent coordonner les libellés. De plus, la conformité de ces systèmes facilite l’intégration d’IA no-code, comme Make ou Airtable. En revanche, négliger ces obligations expose à des contrôles et à une perte de confiance client.

Haut risque : obligations strictes et exemples concrets

Les systèmes classés haut risque font l’objet d’exigences strictes. Les obligations couvrent la gestion des risques, la qualité des données et la traçabilité. Elles imposent aussi des tests préalables et des contrôles humains adaptés. En pratique, sont concernés les outils de recrutement, les systèmes de crédit, l’évaluation des risques pour les infrastructures critiques, et d’autres usages listés à l’Annexe III. Pour une SME belge utilisant un système de scoring, cela implique des audits techniques et des registres détaillés. De plus, il faudra probablement procéder à des évaluations d’impact et à des tests de biais.

S’inscrire dans la base EU et mettre en place des logs détaillés devient nécessaire. Ces mesures permettent la surveillance post-marché et la traçabilité. De plus, la documentation obligatoire facilite les inspections. Les équipes internes doivent prévoir des procédures documentées pour la gouvernance IA. En effet, des sanctions lourdes sont prévues en cas de non-respect. Pour des dirigeants, il est prudent d’anticiper ces coûts. De plus, externaliser certains audits permet de gagner en expertise et en crédibilité.

Risque inacceptable : interdictions et limites claires

Le niveau inacceptable regroupe les usages interdits par le règlement. Parmi eux figurent la manipulation subliminale et la notation sociale. Également proscrite, la reconnaissance biométrique en temps réel dans l’espace public. Ces interdictions visent à protéger les droits fondamentaux et la dignité humaine. Pour une PME belge, cela signifie qu’il n’est pas possible de développer ou d’utiliser ces technologies dans le cadre commercial. De plus, les partenaires et fournisseurs doivent garantir qu’ils ne recourent pas à ces pratiques.

Il est essentiel d’intégrer ces interdits dans vos évaluations contractuelles. Vérifiez les clauses des fournisseurs de modèles et d’API. Par exemple, certains outils de surveillance vidéo peuvent incorporer de la reconnaissance faciale. L’usage de telles fonctions est proscrit dans l’espace public. Ainsi, une attention particulière est nécessaire lors de la conception de solutions de sécurité. De plus, communiquer clairement ces limites aux équipes évite des erreurs opérationnelles coûteuses.

Que faire concrètement ? Feuille de route pour les PME belges

La première étape consiste à inventorier vos systèmes d’IA. Cartographiez les finalités, les données et les utilisateurs. Ensuite, évaluez le niveau de risque selon les critères de l’AI Act. Impliquez DSI, conformité et opérationnels dès le départ. Par exemple, identifiez si un outil de recrutement utilise des variables sensibles. Si oui, préparez un plan de mitigation et des audits. De plus, priorisez les systèmes haut risque pour des actions rapides.

Mettez en place une gouvernance proportionnée. Définissez des rôles clairs pour la gestion des risques IA. Documentez les processus de validation, de test et de surveillance post-déploiement. N’oubliez pas d’intégrer la conformité RGPD et les audits techniques. Pour les PME belges, de nombreuses ressources publiques existent. SPF Économie et Digital Wallonia proposent des guides pratiques. Enfin, prévoyez un calendrier pour la mise en conformité avant 2026 pour les systèmes existants.

Conclusion

L’AI Act impose une logique pragmatique et graduée. Pour les dirigeants belges, la priorité est une cartographie claire des outils IA. Priorisez la conformité pour les systèmes haut risque. Adoptez des mesures simples pour les solutions à risque limité. Si besoin, nous pouvons vous aider à établir votre feuille de route et vos audits.